1月17日 · Uncategorized · 10 分钟

论文研读:**OverLoCK: An Overview-first-Look-Closely-next ConvNet with Context-Mixing Dynamic Kernels** 省流版本:模拟人从粗看到细看的过程,设计了一个CNN based backbone,将模型理解图像的过程分为overview和focus两步,并且引入了根据全局上下文来动态生成卷积核参数的架构。 ## 文章概览 之前的视觉神经网络大多采取了层级结构作为主干网络,从低到高提取特征,缺

1月12日 · Uncategorized · 53 分钟

PPT里面的内容不要写不会的, 主要根据PPT里面的内容+助教给的问题进行提问 ## 小组汇报 3-5个问题: 所有人都要上台,问题谁回答都行。 汇报人数自行安排 ## 录音中提到的核心讨论问题 1. 关于NEMO论文的锚帧选择:为何选择这些矛盾,以及这些矛盾的重要性。锚帧经超分辨率增强后的收益,通过何种技术传递给其他帧。 2. 4篇论文X3个模块都有一个问题->需要准备设计的理念,每一个模块为什么要这么设计。 ## 书面汇报 > 每一个人自己写一份,使用老师发的报告 前言

1月11日 · Uncategorized · 8 分钟

我用的工具和佬友一样,我觉得挺好用的,效率问题大概就是工作流需要优化一下,我的工作流大概如下,佬友可以参考一下,看看是否对佬友那边的流程有优化价值: 一个模型的组成无非就是`Baseline+模块A+模块B+模块C+...` 对于论文阅读阶段,目的就是从论文中寻找 Baseline 和模块,这个阶段的工作可以借助 AI 来完成,模型使用的是 Gemini, 感觉 Gemini 对于教学,解释内容挺容易理解的。 对于寻找Baseline的话,就需要精读论文了,首先可以使用AI先

12月23日 · Uncategorized · 6 分钟

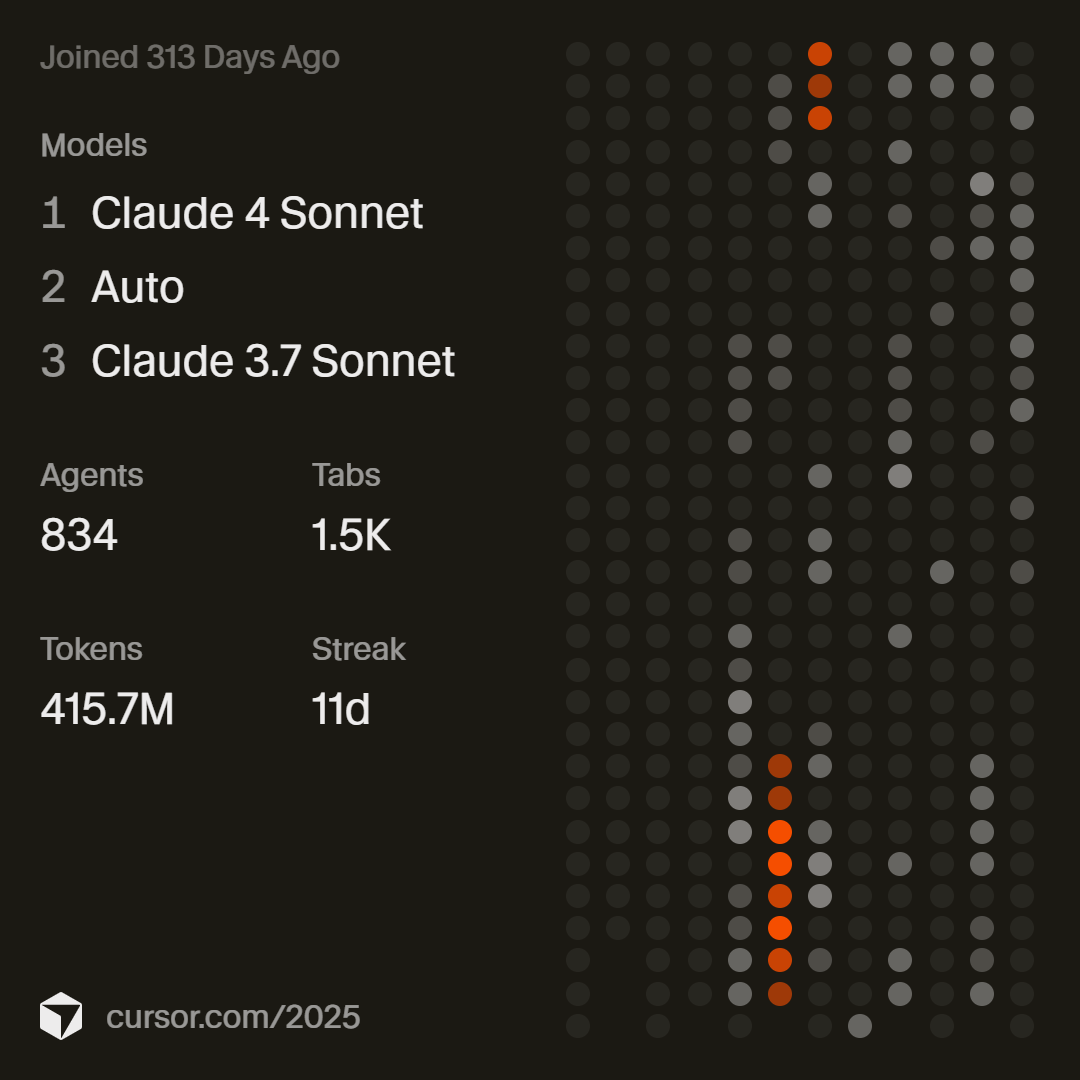

这个标题我酝酿了有半个月了,又一天中午睡醒赶去上课的时候,从脑子里蹦出来这个标题,觉得很有意思,就一直记到现在。 今天看了看cursor和chatGPT的年度总结  chatGPT给我的年度诗篇 ```text

12月21日 · Uncategorized · 41 分钟

作者:bigpunch 链接:https://www.zhihu.com/question/1913413189753877312/answer/1985848243595276793 来源:知乎 著作权归作者所有。商业转载请联系作者获得授权,非商业转载请注明出处。 我大概看了一下你的描述,基于LLM Agent的狼人杀,微调[Llama](https://zhida.zhihu.com/search?content_id=761941846&content_type=Ans

12月17日 · Uncategorized · 17 分钟

## [研乙己——“Hello World“的七种写法](https://zhuanlan.zhihu.com/p/1975505848919934298) [](https://www.zhihu.com/people/gua-fei-44) [三枪一个麻辣烫](https://www.

12月16日 · Uncategorized · 30 分钟

## 深度学习里明明有一个很好的idea,但是跑出的效果不理想,是否可以稍微人工干预? [深度学习里明明有一个很好的idea,但是跑出的效果不理想,是否可以稍微人工干预?](https://www.zhihu.com/question/666647497/answer/1982175646961665485) [![bigpunch](https://pic1.zhimg.com/50/v2-565255a6bd673af58e060f736e8fda99_l.jpg?sou

12月9日 · Uncategorized · 85 分钟

<div style="font-family: Georgia, serif; text-align: center; max-width: 600px; margin: 0 auto; padding: 40px 20px; line-height: 1.6; color: #111;"> <h1 style="font-size: 2.8rem; font-weight: 700; margin: 10px 0;">ICS实验报告</h1> <p style="font

12月9日 · Uncategorized · 42 分钟

看到你说研0非LLM相关,手里没大算力,又觉得RAG和Agent偏工程没什么可研究的,我仿佛看到了五六年前那一波做CV的学生,也是对着ImageNet的大模型望洋兴叹。但其实,咱们得把思路打开,算力贫民窟里也能炼出金子,而且往往这地方出来的东西,比堆算力更有思考深度。 我们要先打破一个巨大的误区,就是觉得只有预训练Pre-training才叫研究,只有跑得动70B甚至更大的模型才叫搞LLM。这个观点在大厂里盛行,是因为他们有卡,他们有资本去烧。但作为学术界,尤其是作为一个独立

12月6日 · Uncategorized · 8 分钟

做任何事情、选择任何一条道路之前,都先问一下自己: - 我选择这个道路是为了什么? - 能否通过其他的渠道获得我同样想要的东西呢? ## Meta Recognition 进入Nova之后,对自己的元认知感觉要清晰了一些。 我是一个缺乏社交、不擅长交流和沟通,做事情不够缜密的人; 我是一个对很多东西好奇,喜欢捣鼓各种东西,但是没有长期毅力把一件事情做下去的人; 我是一个会经常被负面情绪占满,并且把负面情绪视作常态的人; 我是一个很想要表现自己,但是却没有什么本事的人。 我认为